让模型于本地电脑之上学会去做特定工作,并且保持稳定可靠的输出,这一事情比想象之中的更具难度。尽管已然拥有了便捷的工具以及强大的新模型,然而怎样达成准确高效,依旧是诸多开发者以及团队所面临的现实问题。

模型微调的基本途径

把通用大模型转变为专业助手,重点借助微调技术,这有如给一个知识丰富却不够专长的员工开展岗前培训,通过给他给予大量专业案例,像法律合同的条款样本或者医疗诊断报告的撰写范例,模型可以渐渐领会特定领域的语言模式与逻辑。

核心价值由领域知识引进达成。细讲情况,擅长随意聊天话语的通用模型,经几千条高质量编程问答数据培训,这之后会显著提升代码生成的精准度与规范性。该项培训并非从零开始,是在原有庞大知识体系上实行针对性的加固与标定,以此实现相关效果。

高效的开放模型系列

3系列开放模型于近期发布,这为本地代理式AI应用给予了新的选择,该系列中有Nano型号,像30B参数的版本,它依旧保持着较强能力,同时非常显著地优化了计算效率,它格外适合在个人电脑上运行,可以处理像软件调试、内容摘要这类日常任务。

这个系列里,更高阶的型号,像Super与Ultra,是面向更复杂场景的 ,Super型号是专门为多智能体协作设计的,这类协作需要高精度推理 ,而Ultra型号能够应对极其复杂的专业应用 ,它们都支持长达100万token的上下文 ,以此确保在处理长文档或者多步骤任务的时候不会丢失关键信息 。

微调技术的不同层次

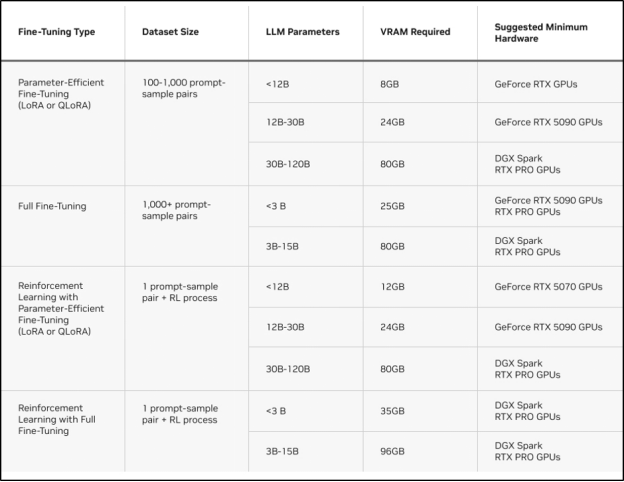

基于需求以及资源,微调技术主要被划分成了两大类。参数高效微调仅仅更新模型极微小部分的参数,其速度快且成本低,适宜于快速适配新任务或者风格。举例来说,就是要让模型掌握运用更正式或者更活泼的语气去回答用户所提出的问题。

如若是完整微调,那么就会去更新模型的所有参数,这对于计算以及内存的要求是极高的,它适用于那种需要深度重塑模型能力的场景,像是可以让模型于一个全新科学领域中达到精通的程度,又或者是构建出能够自主规划并且执行一系列动作的智能体情形。这种方式所产生的训练效果会更加彻底,然而其代价同样也会更大。

训练与推理的结合

有一种更前沿的思路,那便是把训练的过程,跟推理的过程相互交织在一起。模型在对用户请求作出响应的同一时候,还能够依据实时反馈,展开微小的调整以及学习。这样的动态适应能力,对于构建高度自主的,且能长期运行的智能体来讲,是至关重要的。

它能够跟上述提及的微调技术一块儿运用。举例来说,有一个借助完整微调已然掌握法律知识的模型,在后续服务期间,还能够凭借跟律师用户的每一回互动,持续提升其条款建议的精准程度,达成边用边学这一状态。

本地部署的硬件支撑

对这些工作于个人电脑上予以运行,强大的本地硬件是绝对缺失不得的。新一代的紧凑型AI 计算设备,像是基于Grace架构的桌面级产品,其最高能够供给1 PFLOP的AI计算性能,并且配备有8GB与统合内存的1千兆字节。这将以往个人电脑于内存方面的限制状态破除了。

具备更大内存,这使得开发者能够于本地运行参数量更为庞大的模型,得以开启长度更长的上下文窗口,并且能够承担负载更高的完整微调任务啊。特别是针对那些依赖强化学习、对内存吞吐量有着极高要求的工作流而言,在这样的硬件之上运行时速度提升极为显著呢。

从云端到边缘的优化

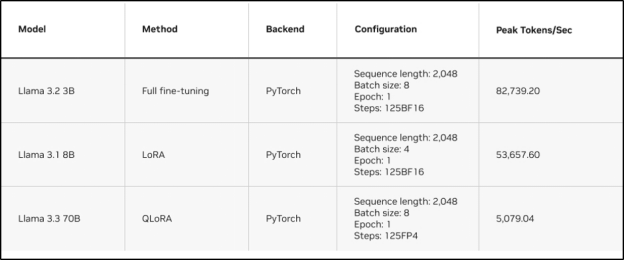

整个技术生态正朝着对本地实验更具有利于态势的方向演进,全新的3系列模型自设计起始便将从云端至个人设备的全链路优化纳入考量范畴,它们能够借助流行的开源框架实现快速的本地部署以及测试,这极大程度地削减了开发者的起步门槛。

那些针对于 GPU 的深度层面的优化,跟简洁且易用的微调软件相互结合起来了,以至于曾经高到没办法到达的模型定制技术,正逐渐变得对于更广阔范围的开发者以及 AI 爱好者能够接触到了句号。个人电脑正在变成一个具有真正意义的智能体研发以及部署的平台句号。

对于那些想要于本地个人电脑之上搭建专业人工智能辅助工具的程序开发者而言,你觉得当下所面临的最为突出的限制因素是模型具备的能力、用于计算的资源,抑或是易于使用的工具链条呢?欢迎来分享你所拥有的观点。