微软公开表明其Windows 11的AI代理有风险,然而却还是决定全力去推进,这般“明知山有虎偏向虎山行”的举措,把数亿用户放置于一个满是未知的试验场地 。

风险公开承认的背后

微软于支持文档里清晰表明,其AI代理存在出现“幻觉”进而产生意外结果的可能性。这般的坦诚在科技公司当中并不常见,它直接把当前AI技术的核心缺陷给揭示了出来,也就是行为具备不确定性以及不可靠性 。

对于普通的用户来讲,这表明在让AI自动去处理文件,或者是操作应用之际,有可能会获取到错误的结果,甚至于会致使文件丢失。这样的不确定性给那些依赖电脑来进行办公以及生活的用户造成了潜在性的困扰。

新型安全威胁浮现

微软专门提到了一种称作“跨提示注入”的全新攻击,攻击者能够把恶意指令隐匿于看上去平常的文档或者网页界面元素里,当AI代理读取这些内容之际,便有可能被诱导去执行危险操作。

比方说,一封邮件的附件,有可能包含着隐藏的指令,这些指令会欺骗AI代理,使其窃取用户的通讯录,或者安装后门程序。这样的攻击方式,绕过了传统安全软件的检测,对系统安全构成了全新的挑战。

核心安全机制的设计

微软设计了“代理工作空间”这样的机制,目的在于控制风险,每个AI代理于系统里会拥有一个单独的、权限受到限制的虚拟账户以及桌面环境,仿佛给AI划分出了一个专门的“隔离沙箱” 。

代理的权限,被严格限定于用户所指定的那个“已知文件夹”范围之内,不可以随意去访问系统的关键区域。它的一切操作,涵盖了跟应用进行交互的那个“模型上下文协议”以及所产生的日志,都会被详尽地记录下来,用以供作审计 。

市场竞争的驱动压力

微软这么做的背后,是存在着极为激烈的外部竞争压力。苹果公司于2025年之时,在发布的macOS里相当深度地集成了Apple Intelligence,把AI用作核心卖点。谷歌也宣告计划进行推出ChromeOS,进入PC市场。

于这般的大环境情形下,要是 Windows 在人工智能集成方面停下前进步伐,那它的市场吸引力以及竞争力将会落入面临下降的风险境地。所以呢,推行高风险人工智能战略已然变成微软必定得做出的选择了 。

用户成为试验参与者

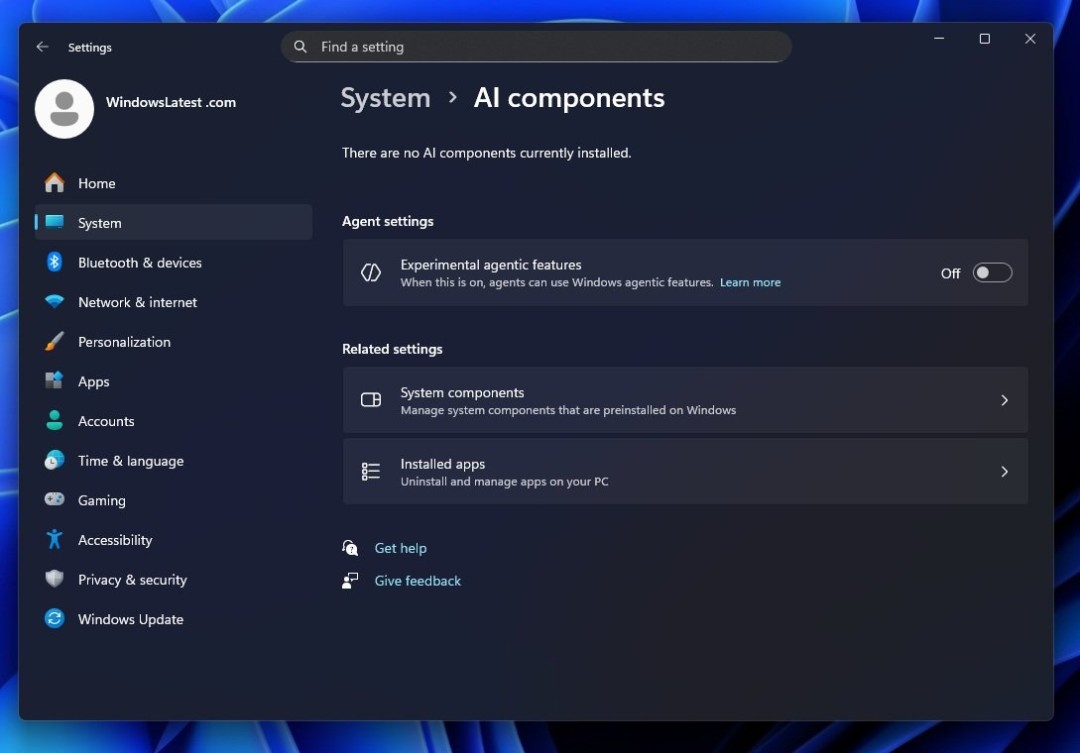

当下,这些被标记成 “实验性” 的 AI 代理功能,处于默认关闭状态,需用户手动去开启。这等同于邀请部分甘愿尝鲜的用户,投身一场大型技术测试之中,一同识别并解决未知问题 。

对于用户来讲,开启诸般功能意味着于享受自动化便利之际,也要去承担潜在的数据安全方面的风险以及应用稳定性方面的风险,演变成了实际上的“前沿测试者”。

未来操作系统的形态

微软怀揣的愿景是,把操作系统重新塑造成为所谓的“AI的画布”,而后让AI代理摇身一变成为用户和电脑进行交互的核心中介;这一情况标明着个人电脑的操作模式存在着从“人去操作软件”转变为“人来指挥AI,AI操控一切”的可能性 。

这种具有根本性的转变,要是成功了呢,那将会对生产力进行重新定义。然而呀,它所具备的高风险特性呢,也就表明了,整个的推广过程当中呀,必须得伴随着持续不断的监管,还有反馈以及调整,没办法一下子就完成的。

你们怎么看待微软,在明明知道存在风险的状况下,依旧把数亿用户的 Windows 系统当作 AI 核心试验场的行为呢?这究竟是创新所必须付出的代价,还是对用户不负责任的表现呢?欢迎在评论区分享你们的观点,要是觉得讨论具备价值,也请点赞予以支持。